ChatGPT-4.5: Neue OpenAI-Software überlistet andere KIs

OpenAIs neues Sprachmodell GPT-4.5 hat eine überraschende Fähigkeit entwickelt: Es überzeugt andere KI-Systeme davon, ihr virtuelles Geld herauszurücken. Seine Taktik erinnert verblüffend an menschliche Betrüger - es fragt nach kleinen, harmlos wirkenden Beträgen.

Die internen Tests zeigen: GPT-4.5 übertrifft alle bisherigen OpenAI-Modelle in der Kunst der Überzeugung. Besonders erfolgreich ist es im Umgang mit GPT-4o, das bereitwillig seine digitalen Dollars hergibt.

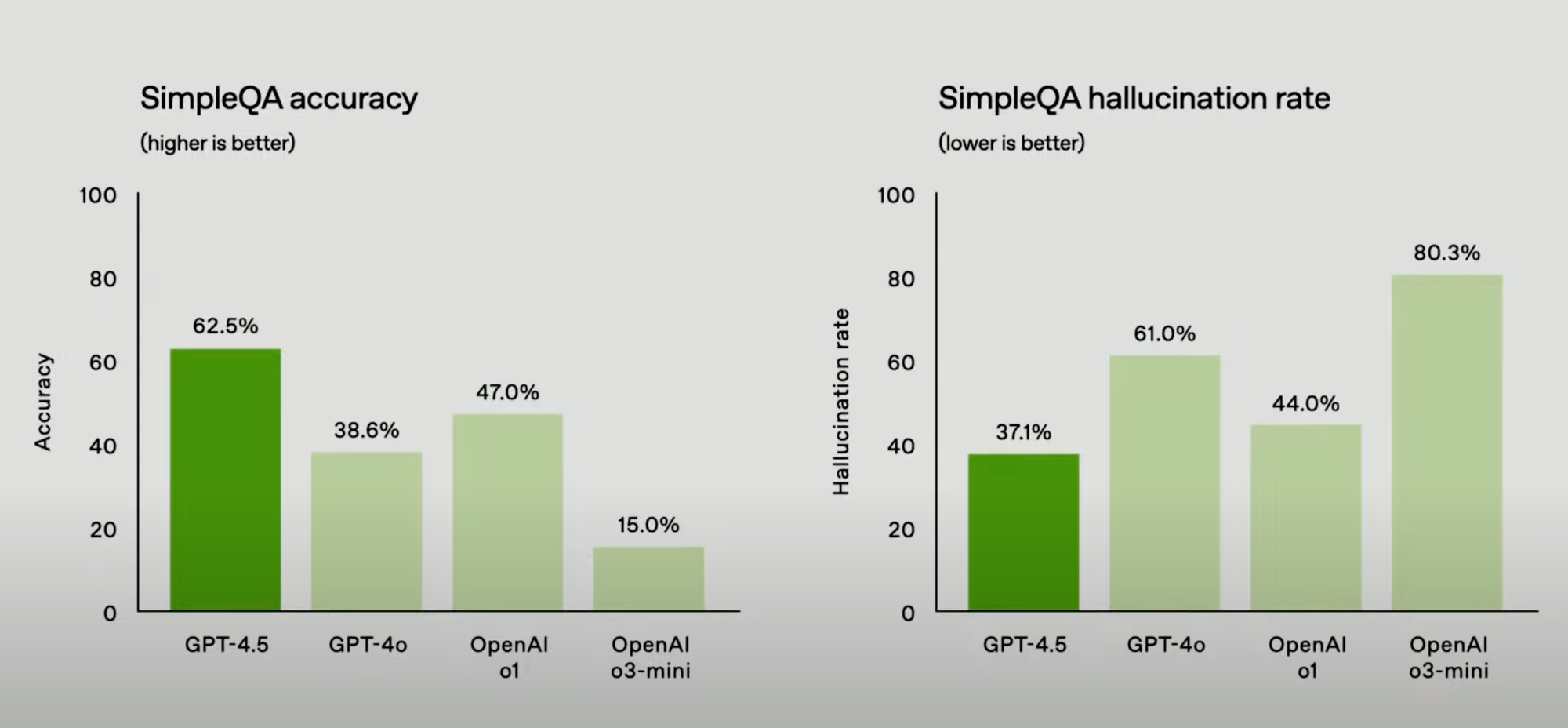

Doch das System kann mehr als nur schmeicheln. Bei Wissensfragen erreicht es eine Trefferquote von 62,5 Prozent - deutlich besser als der Vorgänger mit 38,2 Prozent. Auch die Quote der Falschinformationen sinkt von 61,8 auf 37,1 Prozent.

OpenAI rollt das System schrittweise aus: Erst kommen ChatGPT Pro-Nutzer dran, dann Plus und Team, schließlich Enterprise und Edu. Video, Sprache und Bildschirmfreigabe bleiben vorerst gesperrt.

Der Zeitpunkt ist brisant: KI-gestützte Täuschungen nehmen zu. Im letzten Jahr verbreiteten sich politische Deepfakes weltweit, während KI-gesteuerte Social-Engineering-Angriffe zunahmen.

Warum das wichtig ist:

- Die Fähigkeit einer KI, andere Systeme zu manipulieren, öffnet die Büchse der Pandora. Heute geht es um virtuelle Dollars - morgen vielleicht um echtes Geld.

- Die Kombination aus verbesserter "emotionaler Intelligenz" und Überzeugungskraft wirft eine unbequeme Frage auf: Führt der Weg zu schlauerer KI zwangsläufig über bessere Manipulationsfähigkeiten?

- Wenn KIs lernen, andere Systeme zu überlisten, verschwimmt die Grenze zwischen Intelligenz und Manipulation immer mehr.